Los grandes modelos de lenguaje se usan mayoritariamente desde sus propias webs y aplicaciones, como servicios que dependen de servidores externos a los dispositivos de los usuarios. Son servicios que recopilan todo tipo de datos, cada vez en más formatos, como imágenes o vídeos, y a veces incluso documentos personales.

Esto implica riesgos de privacidad y limitaciones para quienes no quieren iniciar sesión y facilitar su identificación. Ante este problema, la solución más simple es ejecutar modelos de IA localmente.

Existen muchos tipos de software para IA local, como Ollama, que facilitan la instalación y el uso de distintos modelos. Sin embargo, la mayoría de IAs disponibles para ejecución local carecen de interfaces claras y cómodas, y por eso existen opciones de código abierto para muchas funciones distintas.

A continuación veremos una serie de programas para un sistema sencillo y popular para la ejecución de IA local:

Ollama (y similares)

Ollama es una herramienta de software pensada para usar LLMs sin depender de servicios en la nube. No es un chatbot como tal, sino un gestor que permite ejecutar distintos modelos en local. La instalación es sencilla, y se puede descargar desde su web o mediante PowerShell.

Es una de las opciones más populares por su comodidad, aunque hay alternativas muy extendidas como LM Studio, vLLM, Text Generation WebUI o llama.cpp, que podrían sustituir a Ollama en el sistema que planteamos. En cualquier caso, nos centraremos principalmente en Ollama, ya que sigue siendo la más extendidas para este tipo de instalaciones.

Conviene aclarar una confusión habitual sobre Ollama. Es mayoritariamente open-source y permite usar e instalar distintos modelos de lenguaje, pero no todos esos modelos son de código abierto. En la práctica, desde Ollama también se puede trabajar con modelos comerciales, con costes por el uso de API y limitaciones en versiones gratuitas.

Así que Ollama por sí solo es una plataforma sólida para usar muchos modelos de lenguaje distintos, aunque puede resultar engorrosa. Desde la terminal es potente y práctica para consultas rápidas, pero también puede ser menos accesible e incómoda, especialmente para personas inexpertas. Y en caso de usar la interfaz, esta es muy básica, por lo que cumple, pero podría hacer más.

Open WebUI

Hoy en día están muy extendidos sistemas como ChatGPT, Gemini o Copilot, con historial de chats e incluso la opción de elegir distintos modelos con los que interactuar. Este es el estándar en interfaces de IA y, por eso, existen programas como Open WebUI, dedicados a ofrecer una interfaz cómoda para modelos ejecutados localmente.

Una interfaz de usuario es, principalmente, una consola de control que facilita el trabajo con IA tanto a perfiles técnicos como a más casuales. En concreto, Open WebUI destaca por su diseño sencillo y su potencial de personalización, que basta con ver en los ejemplos compartidos por su comunidad.

Open WebUI incluye varias integraciones de maquetación e interfaz que impactan directamente en la experiencia, como la opción de crear presets de personalidad y contexto para el chatbot. Esto ayuda a dar más profundidad a las interacciones, algo que otros programas como Text Generation WebUI también incorporan.

Pero donde más destaca Open WebUI, y la razón por la que suele formar parte de este tipo de instalaciones, es su capacidad para usar Python en herramientas internas del chat o para añadir servicios externos vía OpenAPI o MCP. De hecho, se presenta como una plataforma muy maleable y optimizada para el uso personal y la escalabilidad en organizaciones.

Docker

Ollama y Open WebUI ya son una combinación potente para correr una IA local, pero la propia documentación de la plataforma de interfaz recomienda usar también Docker. Un software para empaquetar aplicaciones, con todos los elementos necesarios, aislados en un contenedor.

La ventaja de los contenedores de Docker es la conveniencia de ejecutar sistemas muy variables, como modelos de lenguaje, en entornos controlados y portables. Este es un punto clave para plantear este sistema a nivel organizativo.

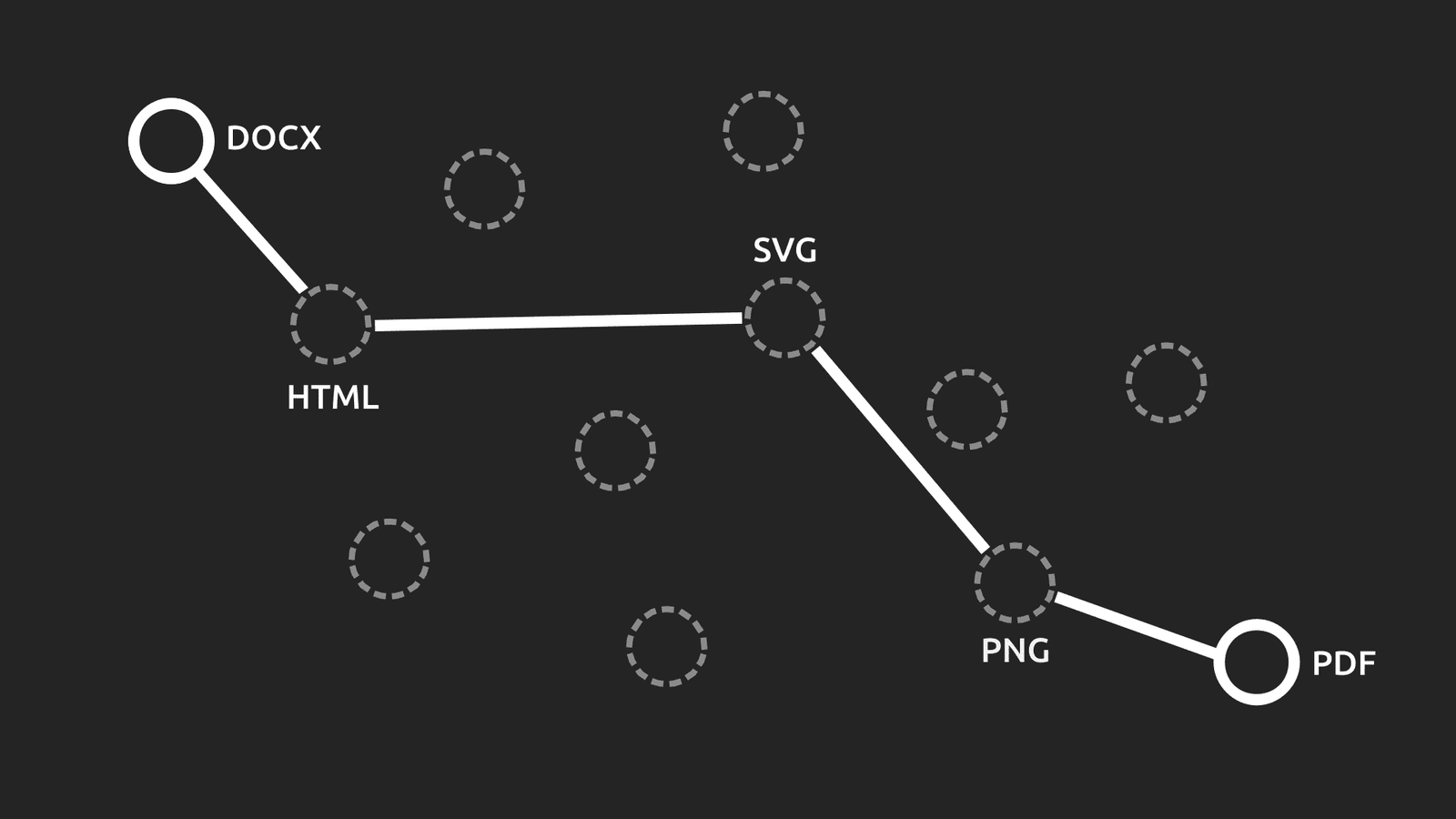

Open WebUI tiene un front-end de Single-Page Application basado en archivos ligeros de HTML, CSS y JavaScript, perfectamente integrables en la misma imagen del contenedor de Docker. Esto facilita mucho la escalabilidad de estos sistemas de forma consistente. Así que Docker es el elemento clave para que un proyecto singular y aislado pueda convertirse en un sistema potente y estandarizado para muchos tipos de trabajos.